KI in der Schweiz: Gute Rahmenbedingungen mit bewährten Instrumenten

- Introduction Executive summary | Positions of economiesuisse

- Chapter 1 Einführung /Ausgangslange

- Chapter 2 Was versteht man unter KI?

- Chapter 3 Regulatorische Spannungsfelder

- Chapter 4 Internationale Entwicklungen

- Chapter 5 Diskussion in der Schweiz

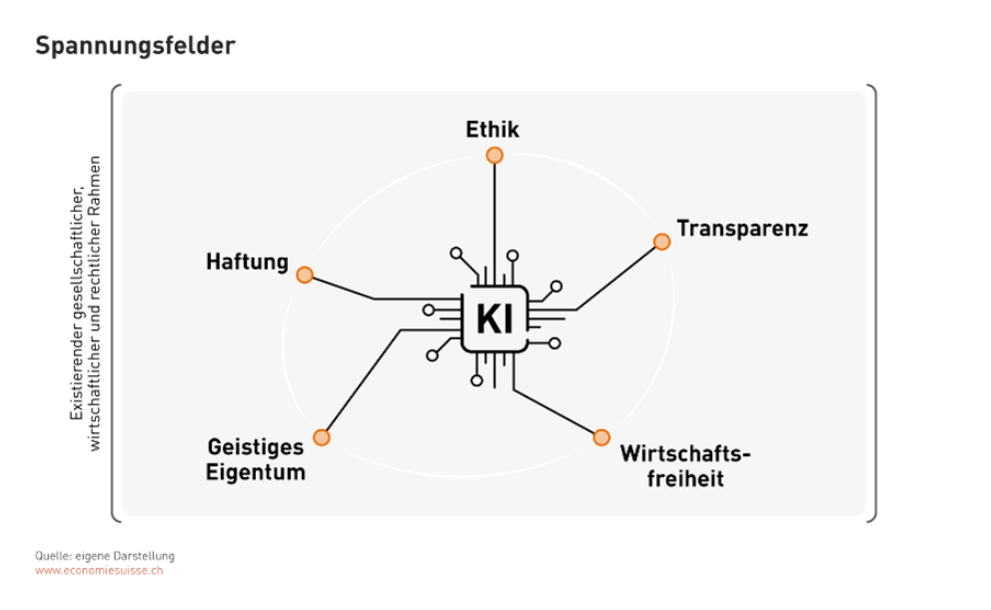

Regulatorische Spannungsfelder

Die Entwicklung der Künstlichen Intelligenz wirft diverse Fragen auf, die nicht nur technischer Natur sind, sondern auch ethische, wirtschaftliche und rechtliche Dimensionen berühren. In dieser Betrachtung wollen wir auf diese wichtigen Themen im Zusammenhang mit KI eingehen und aufzeigen, wie weit diese bereits durch den existierenden gesellschaftlichen, wirtschaftlichen und rechtlichen Rahmen der Schweiz erfasst werden. Auch eine bloss punktuelle Anpassung des Rechtsrahmens hat nur dort zu erfolgen, wo bestehende Regelungen durch entsprechende Auslegung nicht angemessen auf KI-Sachverhalte angewendet werden können. [2]

Ethik

Fragen rund um die Ethik sind sowohl bei der Entwicklung als auch der Nutzung von KI von Bedeutung. Streng rechtlich spielen zwar rein ethische Grundsätze nur soweit eine Rolle, als dass sie ausdrücklich in gesetzlichen Regeln konkreten Ausdruck finden. Die reiche Gerichtspraxis zum allgemeinen Rechtsgrundsatz von Treu und Glauben (Art. 2 ZGB) sowie die Grundsätze einer guten Unternehmensführung (Good Governance) enthalten allerdings zahlreiche Regeln, welche aufgrund der Gedanken von Fairness oder Ethik aufgenommen wurden. Bei KI muss dabei namentlich mitberücksichtigt werden, dass die von KI gesteuerten Prozesse den ethischen Ansprüchen unserer Gesellschaft, das heisst unseren menschlichen Grundwerten und Normen entsprechen.

Die Integration ethischer Prinzipien in den Entwicklungsprozess von KI-Systemen trägt dazu bei, dass die Anwendungen das Vertrauen seitens der Nutzerinnen und Nutzer und damit der Bevölkerung verdienen. Unternehmen sollten sich dabei der Verantwortung bewusst sein, die mit der Schaffung von KI-Technologie einhergeht, und sich verpflichten, ethische Richtlinien zu befolgen.

Unter dem Thema sind folgende Punkte besonders relevant:

Ungleichbehandlung: KI-Systeme können Vorurteile verstärken und fördern, wenn sie nicht auf Basis repräsentativer Datensätze trainiert werden. Dies kann zu einer nicht gerechtfertigten Ungleichbehandlung führen, was sowohl bei der Entwicklung als auch bei der Anwendung von KI-Systemen berücksichtigt werden muss. Es gilt sicherzustellen, dass KI-Systeme in fairer Weise angewendet werden und Differenzierung nur dann gemacht werden, wenn sachlich überzeugende Argumente dies nahelegen.

Es gibt heute bereits rechtliche Instrumente, welche der unsachlichen Ungleichbehandlung entgegenwirken. So besteht in der Schweiz ein verfassungsrechtliches Diskriminierungsverbot [3] , welches sich vor allem an den Staat richtet, aber auch Private bindet, die staatliche Aufgaben wahrnehmen [4] .

Es ist heute in der Lehre breit anerkannt, dass eine unsachliche Ungleichbehandlung beim Abschluss eines Vertrags eine Persönlichkeitsverletzung darstellen kann. Dabei handelt es sich nicht um einen absoluten Schutz vor Ungleichbehandlung, sondern um ein «mittelbares privatrechtliches Diskriminierungsverbot in dem Sinne, dass eine Ungleichbehandlung wegen Merkmalen einer Person, die durch deren Persönlichkeitsrecht geschützt sind, eine Persönlichkeitsverletzung darstellen können [5] ».

Das Persönlichkeitsrecht und das Strafrecht [6] sind auch auf Fälle unfairer oder unlauterer bzw. täuschender KI-Anwendungen anwendbar: Dies beispielsweise bei Deep Fakes, bei denen die beleidigende oder verfälschte Darstellung einer Person eine Verletzung ihres Persönlichkeitsrechts darstellen kann. Bei der Absicht einer Täuschung sind die strafrechtlichen Tatbestände anwendbar, welche ebenfalls technologieneutral formuliert sind [7] .

Auch weitere Erlasse beinhalten klare Gleichbehandlungsgebote für Private. So zum Beispiel das Bundesgesetz über die Gleichstellung von Frau und Mann [8] und das Bundesgesetz über die Beseitigung von Benachteiligungen von Menschen mit Behinderungen [9] .

Gut trainierte KI kann die Ungleichbehandlung verhindern. So können solche KI-Systeme unvoreingenommener sein als Menschen [10] oder gar Muster aus Entscheiden herauslesen, welche eine Ungleichbehandlung aufzeigen.

Privathsphäre und Datenschutz: Bei der Nutzung von KI-Systemen sollte sowohl beim In- wie auch beim Output sichergestellt werden, dass die geltenden Datenschutzbestimmungen eingehalten werden. Relevant ist hierzu in der Schweiz in erster Linie das neue Datenschutzgesetz (DSG). Der Eidgenössische Datenschutzund Öffentlichkeitsbeauftragte (EDÖB) hat Anfang November 2023 bestätigt, dass das geltende Datenschutzgesetz auf KI direkt anwendbar ist [11] . Es kommt für die Bearbeitung von Personendaten durch private Personen und Bundesorgane zur Anwendung [12] . Folgende Bestimmungen sind dabei besonders relevant:

- Datenminimierung (Art. 6 Abs. 2 DSG),

- Informationspflicht/Transparenz (Art. 19 DSG),

- Profiling (Art. 5 lit. f-g DSG),

- Automatisierte Einzelentscheidungen (Art. 21 Abs. 1-3 DSG),

- Auskunftsrecht (Art. 25 DSG).

Eine Analyse der einzelnen Gebiete, welche mit dem Einsatz von KI einhergehen, zeigt, dass der geltende Rechtsrahmen praktisch immer eine adäquate Handhabe bietet. Das ist jedenfalls derzeit der Fall und es wird die Aufgabe des Gesetzgebers sein, Fälle – in welchen durch die Weiterentwicklung der Technologie Lücken im Gesetz entstehen – zu gegebener Zeit zu schliessen.

KI und Staat

Wie ausgeführt, geht das Diskriminierungsverbot im Verhältnis von Staat und Bürger sehr weit, was in einer freien Demokratie wie der Schweiz eine wichtige Grundvoraussetzung für den Respekt der verfassungsmässigen Rechte der Bürgerinnen und Bürger ist.

In seinen Leitlinien «Künstliche Intelligenz für die Bundesverwaltung [13] » geht der Bund auf das Risiko der datenbasierten Diskriminierung bei KI-Entscheiden ein. Er stellt dabei den Menschen, seine Würde und sein Wohl in den Mittelpunkt. Der Einsatz von KI soll «die Chancengleichheit der Menschen unterstützen und deren Zugang zu Bildung, Gütern, Dienstleistungen und Technologie fördern und erleichtern». Die Grundrechte sollen dabei zu jeder Zeit respektiert werden. Dort, wo die Wahrscheinlichkeit besteht, dass Grundrechte beeinträchtigt werden, insbesondere im Zusammenhang mit selbstlernenden Systemen, sollte eine umfassende Folgenabschätzung durchgeführt werden. Dieser Prozess sollte durch kontinuierliche Überwachung ergänzt werden, um angemessene Schutzmassnahmen und Kontrollen zu etablieren. Das primäre Ziel besteht darin, die Betroffenen vor Diskriminierung und Stigmatisierung zu schützen. Gleichzeitig sollte die Wahrung der Privatsphäre durch strikte Einhaltung der Datenschutzbestimmungen gewährleistet werden. Diese Entwicklungen laufen analog zu denjenigen im Europarat. Damit soll auch sichergestellt werden, dass die öffentliche Hand die Instrumente von KI nicht in einer Art und Weise nutzt, welche in einer freien Gesellschaft wie der Schweiz nicht angemessen ist.

Transparenz

Entscheidungen werden in der Regel dann akzeptiert, wenn sie transparent und damit nachvollziehbar erfolgen. Das gilt genauso für Entscheidungen, die unter Nutzung von KI gefällt werden. Nutzerinnen und Nutzer müssen wissen, wann ein Entscheid von einer KI getroffen wurde. Sie sollten auch verstehen, wie KI-Systeme zu ihren Schlussfolgerungen gelangen. Dies fördert nicht nur das Vertrauen, sondern ermöglicht es auch, eventuelle Fehler oder Vorurteile in den Systemen zu identifizieren und zu korrigieren. Die Entwicklung von Methoden zur Erklärbarkeit von KI-Entscheidungen ist daher von entscheidender Bedeutung. Hierzu braucht es transparente Prozesse. Das neue Schweizer Datenschutzgesetz bietet sich als rechtliche Grundlage bereits an: Es sieht weitgehende Transparenzbestimmungen bei automatisierten Entscheiden vor. Gleichzeitig ist vor überschiessenden Anforderungen abzusehen. Auch Entscheidungen, die ohne Nutzung von KI-Systemen zustande kommen, können intransparent sein und auf zahlreichen (zum Teil auch nicht bewussten) Vorurteilen beruhen.

Auch für die OECD ist Transparenz ein wichtiges Instrument zur Sicherstellung der Nachvollziehbarkeit. Sie verlangt von den KI-Akteuren Transparenz, um «ein allgemeines Verständnis von KI-Systemen zu fördern» und die Interaktionen mit KI-Systemen bewusst und verständlich zu machen.

Wirtschaftsfreiheit

Die Wirtschaftsfreiheit und Vertragsfreiheit sind Grundpfeiler einer von freiem Wettbewerb geprägten dynamischen Wirtschaft. In der Schweiz ist die Wirtschaftsfreiheit ein Grundrecht nach Art. 26 der Bundesverfassung. Die Vertragsfreiheit wird im Schweizerischen Obligationenrecht festgehalten. Sie besagt, dass innerhalb der Schranken der Gesetze jede und jeder frei ist zu entscheiden, mit wem ein Vertragsverhältnis eingegangen wird. Eine wichtige Feststellung ist dabei, dass KI-Systeme diese Freiheiten nicht einschränken, sondern unterstützen können. KI kann als Werkzeug dienen, um fundierte Entscheidungen zu treffen und innovative Geschäftsmodelle zu entwickeln. Bei der Regulierung von KI muss sichergestellt werden, dass die Wirtschafts- und insbesondere Vertragsfreiheit garantiert bleibt.

Verträge haben grundsätzlich die Schranken des Obligationenrechts und insbesondere Art. 19 Abs. 2 und Art. 20 Abs. 1 einzuhalten. Gleichzeitig besteht kein Individualisierungsverbot – unabhängig von der Frage, ob eine KI beigezogen wird. Eine Individualisierung im Sinne der Vertragsfreiheit ist grundsätzlich möglich und muss auch weiterhin möglich sein. Die Personalisierung eines Angebots ist eine Grundvoraussetzung für den freien Wettbewerb.

Geistiges Eigentum

Die Fragestellungen zum geistigen Eigentum im Zusammenhang mit KI sind umfassend: KI-Systeme werden oft auf Basis von umfangreichen Datenmengen, Algorithmen und Werken, die von Menschen geschaffen wurden, entwickelt und trainiert.

Auch beim Output von KI-Systemen stellen sich urheberrechtliche Fragen. Bei der Datenverarbeitung mit Künstlicher Intelligenz kann eine digitale Kopie geschützter Daten entstehen, was die Rechte der Urheber verletzen kann. So können Fragmente eines Outputs in ChatGPT beispielsweise urheberrechtlich geschützt sein und der Nutzer begeht eine Urheberrechtsverletzung, ohne dies zu realisieren.

Weiter stellen sich Fragen zur Urheberschaft von durch KI produziertem Output. Falls KI kostengünstig immaterielle Güter produzieren kann, muss das Immaterialgüterrecht allenfalls neu angepasst werden. Besonders wenn KI-Systeme eigenständig kreative Werke schaffen, stellt sich die Frage nach dem Schutz und dem «Erfinder» solcher Werke. Wenn es schwierig wird, kreative oder erfinderische Handlungen eindeutig Menschen oder KI-Systemen zuzuordnen, könnten herkömmliche Kriterien wie «geistige Schöpfung» und «erfinderische Tätigkeit» herausgefordert werden. Denn kann einem durch KI hergestellten Produkt eine geistige Leistung zugerechnet werden? Hierzu wird sich eine Rechtsprechung entwickeln müssen, die die Grenzen des Immaterialgüterrechts in Bezug auf KI definiert.

Auch im Patentrecht werfen die Möglichkeiten von KI Fragen auf. So ist es zum Beispiel offen, ob KI auch Erfinder sein kann oder wem dann diese Rolle zufällt, respektive ab welchem Grad der Selbstständigkeit nicht mehr der Mensch, der die KI einsetzt, als Erfinder gilt. Hier gilt es vorerst auf die ursprüngliche Idee der jeweiligen Gesetzgebung zurückzugehen und diese auf die jeweilige Situation in Bezug auf KI anzuwenden.

Zurzeit besteht aber kein dringender Bedarf einer Anpassung am Immaterialgüterrecht aufgrund von KI, da das geltende Recht für die unmittelbare Zukunft genügend Flexibilität zu bieten scheint. Die Gerichte werden die relevanten Rechtsbegriffe weiterentwickeln und gemeinsam mit den in Fachkreisen geführten Diskussionen wird sich so eine geeignete Herangehensweise finden. International gibt es hierzu bereits Ansätze, über die Gerichte die offenen Fragen zu klären. Das ist auch in der Schweiz möglich.

Haftung

Der Betrieb von KI-Systemen ist mit gewissen Verantwortungsrisiken verbunden. Hierbei stellt sich zuallererst die Frage der Autonomie und danach auch, ab wann KI wirklich einen Schaden herbeigeführt hat.

Als Beispiel kann man sich einen Rasenmähroboter vorstellen, der statt der eigenen Wiese die Blumen des Nachbarn mäht. Es gibt nun zum einen den Nachbarn, der für die Blumen vergütet werden will, den Besitzer des Roboters, der vom Nachbarn zur Zahlung aufgefordert wird, und den Hersteller des Roboters, bei dem der Besitzer Regress nehmen wird.

Es gilt hier zwischen Fehlentscheiden und Fehlern am Produkt zu differenzieren. Von Ersterem spricht man, «falls bei der Auswahl zwischen Alternativen dasjenige Verhalten gewählt wird, das zu einem Schaden bzw. zu einer Vergrösserung des Schadens führt», währenddem ein Fehler am Produkt «auf einen Defekt an den Komponenten […] zurückzuführen» ist.

In der Schweiz regelt unter anderem das Produktehaftpflichtgesetz (PrHG) die Haftung des Herstellers für fehlerhafte Produkte. Das PrHG weist Nähen auf zur Europäischen Richtlinie 85/374/EWG, die aktuell und insbesondere aufgrund der schnellen technologischen Entwicklungen revidiert werden soll. Dabei werden verschiedene Schwächen des Produktehaftungsregimes adressiert, zum Beispiel der eingeschränkte Anwendungsbereich auf Produkte trotz zunehmender Bedeutung von Software, die Bestimmung der Fehlerhaftigkeit bei entwicklungsfähigen Produkten oder die Durchsetzbarkeit von Ansprüchen aufgrund der Beweislastverteilung. Auch der Schweizer Gesetzgeber sollte sich ernsthaft mit diesen Fragestellungen auseinandersetzen.

Zumindest heute kann ein KI-System selbst nicht Haftungssubjekt sein, denn es ist nicht rechtsfähig. Auch ist es bisher unklar, ob ein KI-System unter die Software-Definition des Produktehaftpflichtgesetzes fällt. Im Bereich der Haftung gibt es offene Fragen und auch hier wird es spannend sein zu sehen, wie die Rechtsprechung damit umgeht. Die oben genannte Unterscheidung zwischen Produktfehler oder Fehlentscheid wird dabei aber voraussichtlich eine wichtige Rolle spielen.